Introduction

Novembre 2025 marque un tournant décisif dans l'évolution de l'intelligence artificielle. Alors que les modèles de langage ont dominé le paysage technologique ces dernières années, deux tendances majeures émergent désormais : les agents IA autonomes capables de prendre des décisions et d'effectuer des tâches sans intervention humaine, et la multimodalité qui permet aux IA de générer et comprendre simultanément texte, images, audio et vidéo. Ces avancées ne sont plus de simples concepts futuristes, mais des réalités opérationnelles qui transforment profondément les entreprises et les usages quotidiens.

Selon les dernières analyses du secteur, 61 % des entreprises considèrent que l'intégration d'agents IA autonomes est devenue centrale dans leur stratégie de transformation numérique. Cette révolution silencieuse repose sur des innovations techniques majeures, des investissements massifs des géants technologiques et une course géopolitique entre les États-Unis et la Chine pour la souveraineté en matière d'IA.

Les agents IA autonomes : une révolution opérationnelle

Qu'est-ce qu'un agent IA autonome ?

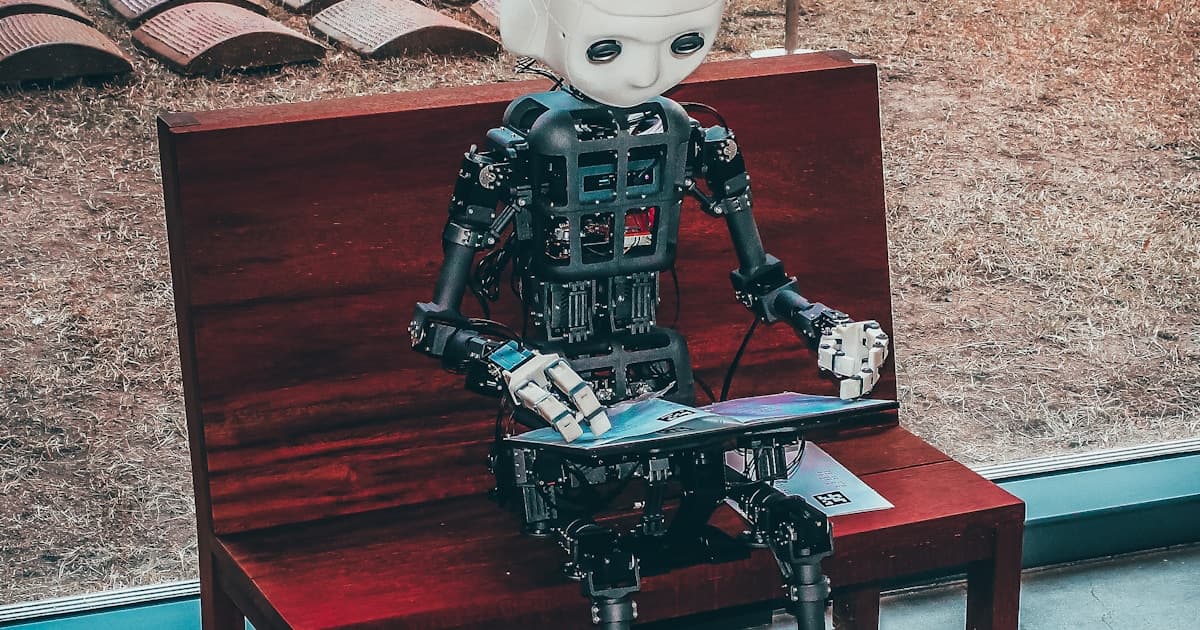

Les agents IA autonomes représentent une évolution fondamentale par rapport aux assistants conversationnels traditionnels comme ChatGPT. Contrairement aux modèles de langage qui se contentent de répondre à des requêtes, ces agents sont capables de planifier, raisonner sur plusieurs étapes, prendre des décisions complexes et exécuter des actions dans des environnements réels sans supervision humaine constante.

En novembre 2025, des modèles comme OpenAI o1 démontrent des capacités de raisonnement avancées impressionnantes. Ces systèmes peuvent décomposer des problèmes complexes en sous-tâches logiques, évaluer différentes stratégies de résolution et adapter leur approche en fonction des résultats intermédiaires. Cette autonomie décisionnelle ouvre la voie à des applications révolutionnaires dans de nombreux secteurs.

Applications concrètes dans les entreprises

Les entreprises adoptent massivement ces agents IA pour automatiser des processus métier complexes. Dans le secteur financier, des agents autonomes analysent en temps réel des milliers de transactions pour détecter des fraudes sophistiquées, en prenant en compte non seulement les montants mais aussi les comportements utilisateurs, les contextes géographiques et les patterns temporels.

Dans le domaine de la santé, des agents IA assistent les médecins en analysant dossiers médicaux, résultats d'imagerie et littérature scientifique récente pour proposer des diagnostics différentiels et des plans de traitement personnalisés. Ces systèmes ne remplacent pas l'expertise humaine mais l'augmentent significativement, permettant aux professionnels de santé de se concentrer sur les aspects relationnels et les cas les plus complexes.

Le secteur du service client connaît également une transformation radicale. Les agents conversationnels autonomes de 2025 peuvent gérer des demandes complexes impliquant plusieurs systèmes, prendre des décisions d'escalade intelligentes et même négocier des solutions avec les clients tout en respectant les politiques de l'entreprise.

Les défis techniques et éthiques

L'autonomie croissante de ces agents soulève des questions techniques majeures. Comment garantir la fiabilité et la sécurité de systèmes capables de prendre des décisions impactantes sans supervision ? Les chercheurs travaillent activement sur des mécanismes de contrôle, des systèmes d'explication des décisions et des garde-fous pour limiter les comportements inattendus.

Les enjeux éthiques sont tout aussi cruciaux. La responsabilité légale en cas d'erreur d'un agent autonome, la protection de la vie privée face à des systèmes observant constamment les comportements humains, et les biais potentiels dans les décisions automatisées sont au cœur des débats. La régulation, notamment avec l'AI Act européen entré en vigueur en 2025, tente d'apporter un cadre juridique à ces technologies.

La multimodalité : vers des IA vraiment polyvalentes

L'évolution vers des modèles unifiés

La multimodalité représente la capacité des IA à comprendre et générer plusieurs types de contenus simultanément : texte, images, audio, vidéo et même données structurées. Cette évolution dépasse largement la simple juxtaposition de modèles spécialisés. Les architectures de novembre 2025 intègrent des représentations communes permettant aux modèles de transférer leur compréhension d'une modalité à l'autre.

GPT-4 et ses successeurs illustrent parfaitement cette tendance. Ces modèles peuvent analyser une image médicale tout en lisant le dossier patient textuel, synthétiser les informations des deux sources et générer un rapport audio pour le médecin, le tout dans un processus unifié et cohérent. Cette capacité de fusion multimodale ouvre des possibilités inédites dans l'éducation, la création de contenu et l'accessibilité.

Applications révolutionnaires de la multimodalité

Dans le domaine éducatif, les IA multimodales créent des expériences d'apprentissage personnalisées qui s'adaptent au style de chaque apprenant. Un étudiant peut poser une question à l'oral, recevoir une explication textuelle enrichie de schémas générés dynamiquement, puis consolider sa compréhension avec des exercices interactifs. Cette flexibilité modale améliore significativement les taux de rétention et de compréhension.

Les créateurs de contenu bénéficient également de ces avancées. Les outils de novembre 2025 permettent de partir d'un script textuel pour générer automatiquement des storyboards illustrés, des voix off naturelles et même des animations vidéo de qualité professionnelle. La barrière technique à la création de contenu multimédia s'effondre, démocratisant la production audiovisuelle.

L'accessibilité connaît aussi une révolution grâce à la multimodalité. Les personnes malvoyantes peuvent désormais recevoir des descriptions audio riches de leur environnement en temps réel via des caméras portables. Inversement, les personnes malentendantes bénéficient de transcriptions instantanées enrichies d'analyses émotionnelles du ton vocal.

Les défis computationnels et environnementaux

Cette puissance multimodale a un coût. Les modèles capables de traiter simultanément plusieurs modalités nécessitent des ressources computationnelles considérables. Un seul modèle multimodal de pointe consomme autant d'énergie pour son entraînement qu'une petite ville pendant plusieurs semaines. Cette réalité pose des questions environnementales urgentes.

Les chercheurs explorent plusieurs pistes pour réduire cette empreinte. Les techniques de compression de modèles, l'optimisation des architectures, et surtout le développement de modèles spécialisés plus petits mais très efficaces sur des tâches ciblées représentent des voies prometteuses. L'objectif est de démocratiser l'accès à ces technologies sans compromettre les objectifs climatiques mondiaux.

La rivalité géopolitique autour de l'IA

États-Unis vs Chine : une course technologique intense

Novembre 2025 marque une intensification de la compétition géopolitique autour de l'intelligence artificielle. Les États-Unis et la Chine investissent des dizaines de milliards dans la recherche IA, avec des approches stratégiques différentes. Les États-Unis misent sur l'innovation privée soutenue par des investissements publics ciblés, tandis que la Chine adopte une approche planifiée centralisée avec des objectifs nationaux ambitieux.

Cette rivalité dépasse le simple aspect technologique pour toucher la souveraineté numérique, la sécurité nationale et l'influence géopolitique. Le contrôle des données d'entraînement, la propriété intellectuelle des algorithmes avancés et la capacité à produire les puces IA les plus performantes sont devenus des enjeux stratégiques majeurs.

L'Europe tente de se positionner sur cette scène avec une approche différente, centrée sur l'IA responsable et la régulation. L'AI Act européen, entrée en vigueur en 2025, impose des contraintes strictes sur les systèmes IA à haut risque. Cette stratégie vise à établir des standards internationaux plutôt qu'à dominer technologiquement.

Investissements massifs et nouvelles réglementations

Meta (Facebook) a annoncé en novembre 2025 un investissement de plus de 20 milliards de dollars pour développer ses infrastructures IA. Google, OpenAI et Microsoft suivent avec des budgets similaires. Ces investissements financent non seulement la recherche mais aussi la construction de centres de données massifs nécessaires à l'entraînement des modèles futurs.

Parallèlement, les discussions sur la régulation s'intensifient. Au-delà de l'Europe, des pays comme le Canada, Singapour et l'Australie développent leurs propres cadres réglementaires. L'objectif est de trouver l'équilibre délicat entre stimulation de l'innovation et protection des citoyens contre les risques potentiels de ces technologies puissantes.

Adoption en France et intégration sectorielle

La France accélère son intégration de l'IA

La France connaît une accélération notable de l'adoption de l'intelligence artificielle en novembre 2025. Le secteur public français a franchi un cap symbolique avec l'annonce que la chaîne franceinfo déploiera des sous-titres automatiques générés par IA sur l'ensemble de sa grille dès le 5 novembre. Cette décision illustre la confiance croissante dans la fiabilité de ces technologies pour des applications grand public sensibles.

Les médias français dans leur ensemble investissent massivement dans l'IA pour la modération de contenu, la personnalisation des recommandations et la production assistée d'articles. Les rédactions utilisent des IA pour générer des premiers jets sur des sujets factuels (résultats sportifs, données financières) que les journalistes humains enrichissent ensuite avec analyses et contexte.

Le secteur de la santé français n'est pas en reste. Les hôpitaux universitaires expérimentent des agents IA pour optimiser la planification des blocs opératoires, réduire les temps d'attente aux urgences et assister les radiologues dans l'analyse d'imagerie médicale. Ces initiatives font de la France un acteur important de l'IA responsable appliquée à la santé.

LinkedIn et la controverse des données d'entraînement

Une polémique a éclaté début novembre 2025 lorsque LinkedIn a annoncé qu'à partir du 3 novembre, la plateforme utiliserait par défaut les données personnelles et contenus créés par ses membres européens (hors messages privés) pour entraîner ses modèles IA. Cette décision a suscité de vives réactions concernant le respect du RGPD et le consentement des utilisateurs.

Cette controverse illustre les tensions croissantes autour de la collecte de données d'entraînement. Les entreprises technologiques ont besoin de volumes massifs de données pour améliorer leurs modèles, mais les utilisateurs sont de plus en plus sensibles à l'utilisation de leurs informations personnelles. Un débat de société s'installe sur l'équilibre entre innovation technologique et protection de la vie privée.

Perspectives et tendances futures

L'émergence de l'IA spécialisée de niche

Contrairement à la tendance initiale vers des modèles universels toujours plus grands, une contre-tendance émerge fin 2025 : les modèles IA spécialisés sur des domaines précis. Ces modèles plus petits, entraînés sur des données hautement ciblées, surpassent souvent les géants généralistes sur leurs tâches spécifiques tout en consommant considérablement moins de ressources.

Cette évolution est particulièrement visible dans les secteurs réglementés comme la santé, la finance ou le juridique, où la précision, l'explicabilité et la conformité réglementaire priment sur la versatilité. Les startups françaises comme Mistral AI se positionnent fortement sur ce créneau des IA spécialisées et souveraines.

L'IA open source gagne du terrain

Les modèles open source comme Llama 3 de Meta, Mistral ou DeepSeek rivalisent désormais sérieusement avec GPT-4 et Claude sur de nombreuses tâches. Cette démocratisation de l'IA avancée permet aux entreprises de taille moyenne et aux chercheurs académiques d'accéder à des technologies autrefois réservées aux géants technologiques.

L'open source favorise également la transparence et la sécurité. Les modèles peuvent être audités par la communauté scientifique, leurs biais identifiés et corrigés collectivement. Cette approche collaborative pourrait devenir la norme pour les applications critiques nécessitant une confiance maximale.

Conclusion

Novembre 2025 restera dans l'histoire de l'intelligence artificielle comme un moment charnière. L'émergence opérationnelle des agents IA autonomes et la maturité des modèles multimodaux transforment concrètement les entreprises et la société. Ces technologies ne sont plus des démonstrations de laboratoire mais des outils quotidiens impactant des millions de personnes.

Les défis restent néanmoins considérables : équilibrer innovation et régulation, garantir une IA éthique et responsable, gérer l'impact environnemental de ces technologies gourmandes en énergie, et assurer que les bénéfices soient partagés équitablement plutôt que concentrés chez quelques acteurs dominants.

La France et l'Europe ont une carte à jouer dans cette révolution en misant sur l'IA responsable, la souveraineté technologique et les modèles spécialisés. Les prochains mois seront déterminants pour établir les standards internationaux qui régiront ces technologies transformatrices pour les décennies à venir.