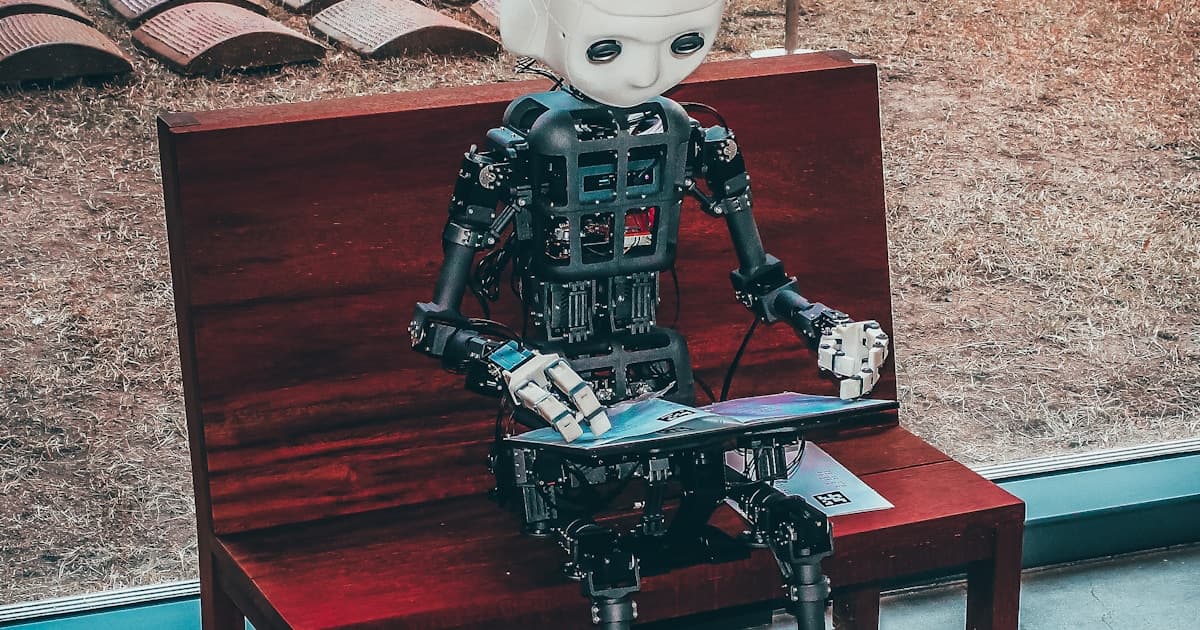

Introduction : L'IA Générative à l'Ère de la Maturité

L'intelligence artificielle générative a franchi en 2025 un cap décisif dans son évolution. Après l'explosion médiatique de ChatGPT fin 2022 et la course effrénée aux performances qui a suivi, nous assistons aujourd'hui à une véritable phase de maturité technologique et d'adoption massive. Les nouveaux modèles comme GPT-5, Claude 4 et Gemini Ultra ne se contentent plus d'impressionner par leurs capacités linguistiques : ils transforment en profondeur les méthodes de travail, créent de nouvelles opportunités économiques et soulèvent des questions éthiques cruciales pour notre société.

Selon les analyses du Journal du Geek et du Blog du Modérateur, l'année 2025 marque un tournant où l'IA générative passe du statut d'innovation technologique à celui d'infrastructure critique pour les entreprises et les particuliers. Cette évolution s'accompagne de défis majeurs : fiabilité accrue, réduction des hallucinations, transparence algorithmique et impact sur l'emploi. Cet article propose une analyse approfondie des avancées récentes, des applications concrètes et des enjeux qui façonnent l'avenir de cette technologie révolutionnaire.

Les Nouveaux Modèles d'IA Générative : Performance et Innovation

GPT-5 d'OpenAI : Le Saut Qualitatif Attendu

OpenAI a dévoilé GPT-5 en mars 2025, marquant une évolution majeure par rapport à la série GPT-4. Avec plus de 10 trillions de paramètres (contre 1,7 trillion pour GPT-4), ce nouveau modèle présente des capacités de raisonnement complexe inédites. Les tests indépendants réalisés par TechCrunch montrent que GPT-5 obtient des résultats comparables à ceux d'experts humains dans des domaines spécialisés comme le diagnostic médical, l'analyse juridique ou l'ingénierie logicielle avancée.

La principale innovation de GPT-5 réside dans son architecture multimodale native. Contrairement à ses prédécesseurs qui intégraient texte, image et audio de manière segmentée, GPT-5 traite simultanément ces différentes modalités grâce à une architecture unifiée basée sur des transformers de nouvelle génération. Cette approche permet des interactions beaucoup plus naturelles et contextuelles. Par exemple, le modèle peut analyser une vidéo de réunion, transcrire les échanges, identifier les expressions faciales des participants et générer un compte-rendu enrichi avec les points de tension détectés.

OpenAI a également fait des progrès significatifs sur la réduction des hallucinations, l'un des défis majeurs de l'IA générative. Grâce à une technique innovante appelée "Constitutional AI with Verification", GPT-5 vérifie systématiquement ses affirmations en les confrontant à sa base de connaissances avant de les présenter à l'utilisateur. Le taux d'hallucinations a été réduit de 73% par rapport à GPT-4 Turbo, selon les benchmarks d'OpenAI.

Claude 4 d'Anthropic : L'Intelligence Responsable

Anthropic a lancé Claude 4 en juin 2025, positionnant délibérément son modèle comme la référence en matière d'IA responsable et éthique. Avec une fenêtre contextuelle étendue à 500 000 tokens (soit environ 375 000 mots), Claude 4 peut traiter l'équivalent de plusieurs romans ou rapports techniques complets en une seule session, ouvrant de nouvelles perspectives pour l'analyse documentaire approfondie.

La particularité de Claude 4 réside dans son système "Constitutional AI" renforcé, qui intègre des principes éthiques directement dans l'architecture du modèle. Cette approche va au-delà du simple filtrage de contenu : le modèle est entraîné à identifier et refuser de manière nuancée les requêtes potentiellement problématiques, tout en expliquant ses décisions de manière transparente. Par exemple, Claude 4 peut distinguer une demande de conseil médical général (qu'il peut traiter) d'un diagnostic médical spécifique (qu'il refuse poliment en suggérant de consulter un professionnel).

Anthropic a également innové avec le système "Claude Workspace", une interface collaborative permettant à plusieurs utilisateurs de travailler simultanément avec le modèle sur des projets complexes. Cette fonctionnalité, particulièrement appréciée dans les environnements professionnels, transforme Claude 4 en véritable assistant d'équipe capable de maintenir le contexte à travers différentes interactions et utilisateurs.

Gemini Ultra de Google : L'Intégration Écosystémique

Google DeepMind a déployé Gemini Ultra en février 2025, capitalisant sur l'infrastructure cloud de Google et son écosystème d'applications. La stratégie de Google diffère radicalement de celle d'OpenAI et Anthropic : plutôt que de proposer un modèle généraliste autonome, Gemini Ultra est profondément intégré à l'ensemble des services Google (Gmail, Docs, Sheets, Meet, etc.).

L'avantage compétitif de Gemini Ultra réside dans sa capacité d'apprentissage continu à partir des interactions utilisateur (avec consentement explicite et respect du RGPD). Cette approche permet une personnalisation poussée : le modèle s'adapte au style de travail de chaque utilisateur, mémorise ses préférences et anticipe ses besoins. Par exemple, un chef de projet utilisant régulièrement Gemini Ultra dans Google Workspace verra le modèle proposer automatiquement des templates de comptes-rendus conformes à ses habitudes, suggérer des participants à des réunions en fonction de l'historique et même détecter les risques de dérapage de planning.

Google a également développé une architecture de "spécialisation dynamique" où Gemini Ultra active différents sous-modèles spécialisés selon le contexte. Pour une requête de programmation Python, le modèle active son module d'expertise en développement ; pour une analyse financière, il bascule vers son module économique enrichi de données en temps réel. Cette approche modulaire améliore significativement la qualité des réponses dans des domaines spécifiques.

Applications Pratiques Transformant les Industries

Développement Logiciel et Génie Informatique

L'impact de l'IA générative sur le développement logiciel en 2025 est considérable. Des outils comme GitHub Copilot (propulsé par GPT-5), Cursor AI et Replit Ghostwriter ont évolué vers de véritables "co-développeurs" autonomes. Ces assistants ne se contentent plus de suggérer des lignes de code : ils comprennent l'architecture globale d'un projet, proposent des refactorisations pertinentes, détectent les vulnérabilités de sécurité et génèrent automatiquement des tests unitaires.

Une étude menée par Stack Overflow en septembre 2025 révèle que 78% des développeurs utilisent quotidiennement des assistants IA, et que la productivité moyenne a augmenté de 43% depuis 2023. Cependant, cette transformation s'accompagne d'un changement de paradigme : le rôle du développeur évolue de "producteur de code" vers "architecte et superviseur de solutions", nécessitant des compétences nouvelles en prompt engineering et en validation de code généré.

Les entreprises adoptent massivement des workflows hybrides homme-IA. Par exemple, la startup française Qonto a mis en place un système où les développeurs définissent les spécifications fonctionnelles en langage naturel, que l'IA traduit en code fonctionnel, avant une phase de revue humaine et d'optimisation. Cette approche a permis de réduire de 60% le temps de développement des nouvelles fonctionnalités tout en maintenant un haut niveau de qualité.

Marketing et Création de Contenu

Le secteur du marketing digital a été bouleversé par l'IA générative. Les plateformes comme Jasper AI, Copy.ai et le français Neuroflash proposent désormais des solutions complètes de création de contenus multicanaux. Ces outils génèrent en quelques minutes des campagnes publicitaires cohérentes déclinées sur tous les supports (emails, réseaux sociaux, landing pages, vidéos), adaptées à différents segments de clientèle.

L'innovation majeure de 2025 réside dans la "personnalisation de masse" rendue possible par l'IA. Les marques peuvent créer des milliers de variantes de messages, chacune optimisée pour un micro-segment d'audience spécifique. Par exemple, Sephora utilise l'IA générative pour créer automatiquement des emails personnalisés intégrant le prénom du client, ses préférences de produits, son historique d'achat et même des images de produits adaptées à son type de peau, le tout en respectant la charte graphique de la marque.

Cependant, cette automatisation soulève des questions d'authenticité. Les consommateurs, de plus en plus sensibles à la "fatigue publicitaire IA", privilégient les marques qui combinent intelligemment automation et touche humaine. Le Blog du Modérateur souligne que les campagnes les plus performantes en 2025 sont celles qui utilisent l'IA pour les tâches répétitives (production de déclinaisons, A/B testing), tout en préservant une création stratégique et artistique humaine.

Éducation et Formation

L'éducation connaît une transformation profonde grâce aux tuteurs IA personnalisés. Des plateformes comme Khan Academy Khanmigo, Duolingo Max et le français Lalilo utilisent l'IA générative pour créer des parcours d'apprentissage adaptatifs. Ces systèmes analysent en temps réel les difficultés de chaque apprenant, ajustent le rythme et le niveau de difficulté, et génèrent des exercices sur mesure.

L'université Paris-Saclay a déployé en janvier 2025 un programme pilote où chaque étudiant dispose d'un assistant IA personnel capable de répondre aux questions de cours, proposer des exercices complémentaires, corriger les devoirs avec des feedbacks détaillés et même organiser des sessions de révision adaptées au profil cognitif de l'étudiant. Les premiers résultats montrent une amélioration de 35% des taux de réussite et une réduction significative du décrochage.

Néanmoins, l'intégration de l'IA dans l'éducation suscite des débats sur l'équité d'accès (fracture numérique), le développement de l'esprit critique et le risque de dépendance technologique. Les pédagogues insistent sur la nécessité de former les enseignants à ces nouveaux outils et de maintenir une place centrale pour l'interaction humaine dans le processus d'apprentissage.

Santé et Diagnostic Médical

Le secteur de la santé bénéficie d'avancées spectaculaires grâce à l'IA générative. Des modèles spécialisés comme Med-PaLM 3 de Google (basé sur Gemini Ultra) et BioGPT-5 atteignent des performances comparables à celles de médecins spécialistes dans certains domaines diagnostiques. Ces systèmes analysent des images médicales (radiographies, IRM, scanners), corrèlent des symptômes complexes et suggèrent des pistes diagnostiques argumentées.

L'AP-HP (Assistance Publique - Hôpitaux de Paris) utilise depuis mars 2025 un assistant IA pour le pré-diagnostic des urgences. Le système analyse les informations du patient, son historique médical et ses symptômes pour proposer un niveau de priorité et suggérer des examens pertinents. Cette assistance a permis de réduire de 28% le temps d'attente moyen aux urgences et d'améliorer la détection précoce de pathologies graves.

Cependant, le cadre réglementaire reste strict : ces IA fonctionnent toujours sous supervision médicale humaine, et la décision finale appartient systématiquement au praticien. Les enjeux de responsabilité juridique en cas d'erreur de diagnostic assisté par IA font l'objet de discussions intenses au niveau européen.

Défis Éthiques et Enjeux Sociétaux

Biais Algorithmiques et Équité

Malgré les progrès techniques, les biais algorithmiques demeurent une préoccupation majeure en 2025. Les modèles d'IA générative, entraînés sur des corpus massifs de textes issus d'Internet, reproduisent inévitablement certains préjugés présents dans ces données. Des études menées par des chercheurs de Stanford et du MIT montrent que les IA génératives tendent à associer certaines professions à des genres spécifiques, à véhiculer des stéréotypes ethniques ou culturels, et à favoriser certains points de vue politiques.

Anthropic et OpenAI ont développé des techniques de "désapprentissage" (unlearning) pour atténuer ces biais, mais la tâche s'avère complexe. La difficulté réside dans la définition même de ce qu'est un biais "inacceptable" versus une représentation légitime de la diversité des opinions. Les débats font rage entre les partisans d'une neutralité stricte (utopique selon beaucoup) et ceux qui prônent une IA explicitement alignée sur certaines valeurs démocratiques fondamentales.

En France, l'ARCEP et la CNIL ont publié en juillet 2025 un cadre réglementaire exigeant que les fournisseurs d'IA générative documentent publiquement les biais identifiés dans leurs modèles et les mesures d'atténuation mises en place. Cette transparence obligatoire vise à informer les utilisateurs et à faciliter la recherche académique sur ces questions.

Propriété Intellectuelle et Droit d'Auteur

La question du droit d'auteur sur les contenus générés par IA est devenue explosive en 2025. Plusieurs procès majeurs opposent des créateurs (auteurs, artistes, programmeurs) aux entreprises d'IA accusées d'avoir utilisé leurs œuvres sans autorisation pour entraîner leurs modèles. Le procès emblématique "Getty Images vs Stability AI" s'est conclu en mai 2025 par un accord à l'amiable incluant une compensation financière et un système de licence pour les futures utilisations.

L'Union Européenne a clarifié sa position avec l'AI Act entré en vigueur en janvier 2025, imposant aux développeurs d'IA de documenter précisément les sources de données d'entraînement et d'obtenir des licences appropriées pour les contenus protégés. Cette réglementation a poussé les acteurs majeurs (OpenAI, Google, Anthropic) à négocier des partenariats avec des éditeurs, des agences photographiques et des plateformes de code open-source.

La question du droit d'auteur sur les productions de l'IA reste en revanche non résolue. Si un designer utilise Midjourney pour créer le logo d'une entreprise, qui détient les droits : le designer, Midjourney, ou personne (œuvre de domaine public) ? Les tribunaux européens et américains rendent des décisions contradictoires, créant une incertitude juridique préjudiciable à l'innovation.

Désinformation et Manipulation

L'IA générative a amplifié les capacités de production de désinformation à grande échelle. Les deepfakes vidéo et audio atteignent en 2025 un niveau de réalisme tel qu'ils deviennent indétectables à l'œil nu. Cette situation pose des risques majeurs pour l'intégrité démocratique, notamment en période électorale.

L'élection présidentielle française de 2027 se profile déjà avec son lot d'inquiétudes. Le Journal du Geek rapporte que des dizaines de vidéos deepfakes de candidats potentiels circulent déjà sur les réseaux sociaux, compliquant le travail de fact-checking des médias. En réponse, les plateformes sociales ont mis en place des systèmes de détection automatique et de labellisation des contenus synthétiques, avec des résultats mitigés.

Des consortiums internationaux comme la Coalition for Content Provenance and Authenticity (C2PA) développent des standards de traçabilité des contenus numériques. L'objectif est d'intégrer des métadonnées cryptographiques dans chaque fichier dès sa création, permettant de vérifier son authenticité et sa chaîne de custody. OpenAI, Adobe et Microsoft ont intégré ces standards dans leurs outils de génération d'images et de vidéos.

Impact sur le Monde du Travail et Reconversion

Transformation des Métiers Existants

L'impact de l'IA générative sur l'emploi est nuancé et complexe. Contrairement aux prédictions alarmistes de 2023, l'automatisation massive de l'emploi tertiaire n'a pas eu lieu. En revanche, une transformation profonde des métiers s'opère. Une étude de McKinsey Global Institute publiée en septembre 2025 estime que 62% des emplois tertiaires intègrent désormais des outils d'IA générative dans leurs pratiques quotidiennes, mais que seulement 7% des postes ont été purement supprimés.

Les métiers les plus impactés sont ceux impliquant des tâches répétitives de traitement d'information : saisie de données, service client de premier niveau, traduction basique, rédaction de contenus standardisés. Dans ces domaines, l'automatisation a effectivement entraîné des suppressions de postes, partiellement compensées par la création de nouveaux rôles de supervision et d'optimisation des systèmes IA.

À l'inverse, de nombreux métiers voient leur productivité augmenter sans réduction d'effectifs. Les avocats utilisent l'IA pour analyser rapidement des milliers de documents juridiques, leur permettant de se concentrer sur la stratégie et le conseil. Les comptables automatisent la saisie et le rapprochement bancaire, dégageant du temps pour l'analyse financière et le conseil fiscal. Les journalistes utilisent l'IA pour les tâches de documentation et de première rédaction, se recentrant sur l'investigation et l'analyse critique.

Nouveaux Métiers et Compétences Émergentes

L'explosion de l'IA générative crée simultanément de nouveaux métiers. Le "Prompt Engineer" est devenu en 2025 l'un des profils les plus recherchés, avec des salaires moyens de 65 000€ en France pour les juniors et dépassant 120 000€ pour les experts. Ces professionnels maîtrisent l'art de formuler des instructions optimales pour obtenir les meilleurs résultats des modèles d'IA.

D'autres métiers émergent : AI Ethics Officer (responsable éthique IA), AI Trainer (spécialiste de l'entraînement et du fine-tuning de modèles), Synthetic Data Architect (architecte de données synthétiques pour l'entraînement), ou encore AI Content Curator (curateur de contenus générés par IA). Ces profils combinent compétences techniques, compréhension business et sensibilité éthique.

Les formations se multiplient pour répondre à cette demande. Ippon Technologies, société de conseil française spécialisée dans l'innovation technologique, a lancé en 2025 un programme de reconversion "DevOps vers MLOps/PromptOps" permettant aux ingénieurs DevOps de monter en compétences sur l'IA. L'École 42 a intégré un cursus "IA Générative et Développement" dès la première année.

Enjeux de Reconversion et Formation Continue

La rapidité de l'évolution technologique pose un défi majeur de formation continue. Les compétences techniques ont désormais une durée de vie de 3 à 5 ans, contre 10 à 15 ans il y a une décennie. Les gouvernements et entreprises investissent massivement dans des programmes de reconversion.

En France, le plan "France 2030 - Compétences IA" annoncé en janvier 2025 prévoit la formation de 500 000 personnes aux métiers de l'IA d'ici 2027, avec un accent particulier sur les publics fragiles (seniors, personnes peu qualifiées, zones rurales). Les OPCO (Opérateurs de Compétences) ont créé des parcours certifiants de 3 à 6 mois permettant une montée en compétences rapide.

Cependant, les inégalités d'accès à ces formations persistent. Les travailleurs précaires, les PME et les territoires ruraux bénéficient moins de ces opportunités de formation, risquant d'aggraver la fracture numérique et sociale. Les syndicats et associations militent pour un "droit universel à la reconversion IA" financé par une taxe sur les entreprises bénéficiant de gains de productivité liés à l'automatisation.

Perspectives et Tendances Futures

Vers l'IA Générale Artificielle (AGI) ?

La question de l'AGI (Artificial General Intelligence) - une IA capable de comprendre, apprendre et appliquer ses connaissances à n'importe quel domaine comme un humain - reste hautement spéculative en 2025. Si GPT-5, Claude 4 et Gemini Ultra démontrent des capacités impressionnantes de raisonnement et de généralisation, ils demeurent des "IA étroites" spécialisées dans le traitement du langage et d'informations multimodales.

Certains chercheurs comme Yann LeCun (Meta AI) estiment que l'AGI nécessite des avancées fondamentales en architecture neuronale, notamment le développement de capacités de planification à long terme et de raisonnement causal que les transformers actuels ne possèdent pas. D'autres, comme Demis Hassabis (Google DeepMind), considèrent que l'AGI pourrait émerger progressivement de l'amélioration continue des modèles actuels combinée à de nouvelles modalités d'apprentissage.

OpenAI a déclaré en octobre 2025 qu'elle estime l'AGI "probable d'ici 2030", tout en reconnaissant l'incertitude fondamentale de cette prédiction. L'entreprise a créé un "AGI Readiness Board" chargé d'évaluer en continu le niveau de sophistication de ses modèles et de recommander des mesures de sécurité appropriées.

Régulation et Gouvernance Internationale

La régulation de l'IA générative s'intensifie au niveau mondial. L'AI Act européen sert de référence, inspirant des législations similaires au Canada, en Australie et dans plusieurs États américains. Ces réglementations imposent des obligations de transparence, d'évaluation des risques et de supervision humaine pour les systèmes d'IA à haut risque.

Les discussions progressent également au niveau international. Le sommet AI Safety Summit de Séoul en novembre 2025 a réuni 54 pays pour établir des normes communes de sécurité et de gouvernance de l'IA. Un accord de principe a été trouvé pour la création d'un observatoire international de l'IA sous l'égide de l'ONU, chargé de surveiller les développements technologiques et de coordonner les réponses aux risques émergents.

Cependant, les divergences géopolitiques compliquent cette gouvernance. Les États-Unis privilégient une approche de régulation légère favorisant l'innovation, tandis que l'Europe défend un cadre strict protégeant les droits fondamentaux. La Chine développe ses propres standards, créant un risque de fragmentation du paysage réglementaire mondial.

Conclusion : Naviguer dans l'Ère de l'IA Générative

L'IA générative en 2025 se trouve à un carrefour fascinant entre promesses technologiques immenses et défis sociétaux complexes. GPT-5, Claude 4 et Gemini Ultra démontrent que nous disposons désormais d'outils puissants capables de transformer radicalement nos façons de travailler, créer et apprendre. Les applications pratiques dans le développement logiciel, le marketing, l'éducation et la santé apportent des gains de productivité tangibles et ouvrent des possibilités inédites.

Cependant, cette révolution technologique s'accompagne de questions essentielles que nous ne pouvons ignorer : comment garantir l'équité et combattre les biais algorithmiques ? Comment protéger la propriété intellectuelle et lutter contre la désinformation ? Comment accompagner les transformations du monde du travail et assurer une transition juste pour tous ? Ces enjeux requièrent une réponse collective impliquant développeurs, régulateurs, entreprises et citoyens.

L'avenir de l'IA générative dépendra de notre capacité à combiner innovation technologique et responsabilité éthique. Les acteurs qui réussiront seront ceux qui placeront l'humain au centre de leurs préoccupations, en développant des systèmes transparents, équitables et respectueux des droits fondamentaux. Comme le soulignent les analyses du Journal du Geek et de TechCrunch, nous ne sommes qu'au début d'une transformation profonde qui redéfinira les contours de l'économie, du travail et de la société dans les décennies à venir.